ENGINEERING IT

Individuality, service, and performance

We develop ground-breaking IT strategies and solutions. Enter the solution boutique: current technology, individuality, and personal consulting.

We present the most recent models, which fit you exactly, and keep you up on all trends. With us, you get a high degree of service and performance according to our credo “Speed & Agility: Get it done”, before the trends are outdated.

- Your business requirements are unique—so is evoila’s IT support.

- We support you—from legacy vSphere to IaaS to PaaS to XaaS.

- We are certified according to TÜV ISO/IEC 27001. Our organization’s and our customers’ information security are paramount.

Our Offers and Services

We offer individual solutions like ecp and IaaS by evoila. With large partners alongside we finish a strong solution portfolio, which is tailored exactly to your IT.

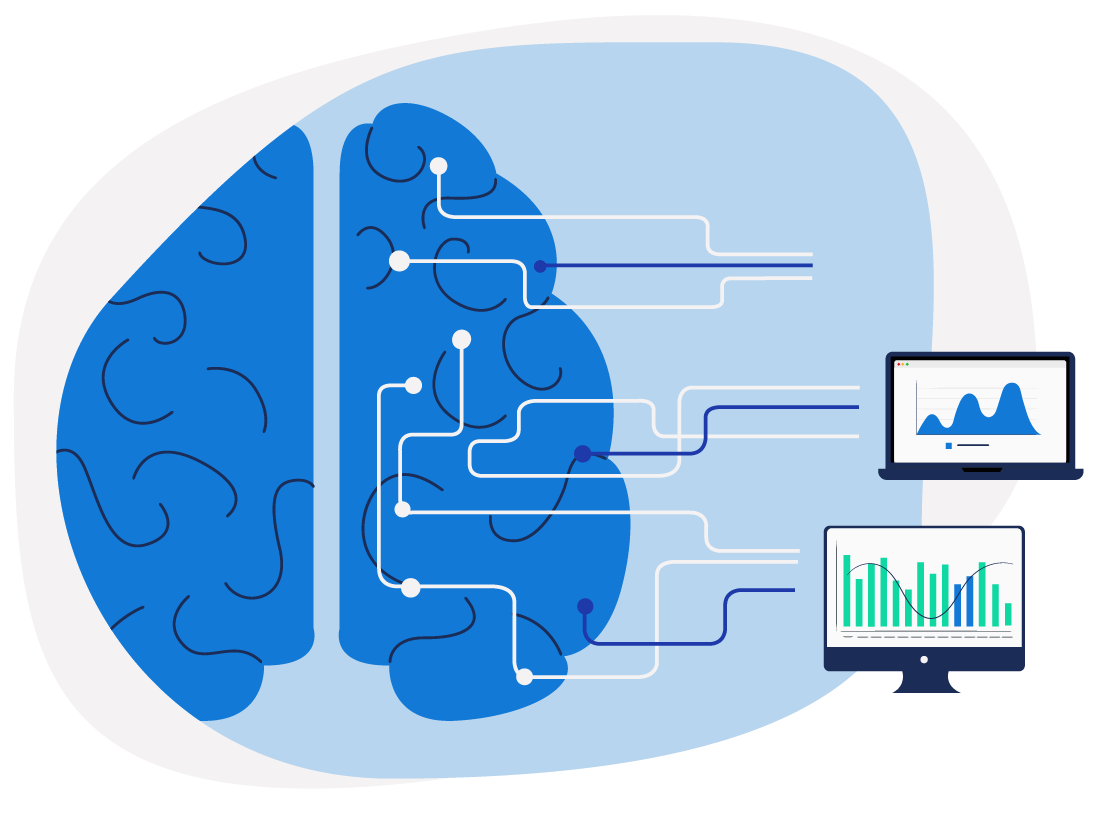

Development

With us, you get a strong partner for cloud native software development—from design to operations. Your custom software with evoila.

Solutions

Find our product and service portfolio here.

Managed Services

Building your cloud environments. From managed data service to managed platform.

Consulting

We help you with planning and budgeting for the future and select technology solutions for your goals.

ISO/IEC I27001, BSI C5 & TISAX®

Information security is paramount

We are certified according to TÜV ISO/IEC 27001. Our whole organization is governed by a systematic IT security information system and risk management. We offer more than standard!

Thanks to the BSI C5 list of criteria, the ISO 27002 stipulations are specifically examined for the cloud context and thereby offer more precise information about information security.

“For evoila group’s managed service line of business, this is an essential step. Thanks to the specific stipulations of the BSI C5 list of criteria, we prove that we not only fulfill the data protection stipulations, but also the stipulations for technical and organizational measures concerning the evoila managed service with the highest possible standard“, says Johannes Hiemer, CEO.

TISAX® (Trusted Information Security Assessment Exchange) is a verification mechanism for information security for automobile companies. TISAX® was developed in this regard to avoid redundant assessments and increase the industry’s efficiency.

Our Partners

News from the Blog

ESET Protect vs. Microsoft Defender for Endpoint

Recently I had a chance to work for a customer who has been using ESET PROTECT antivirus. The Customer however…

Simplifying Kubernetes Monitoring: Insights from KubeCon Paris with Datadog

As the complexity of Kubernetes environments continues to grow, effective monitoring becomes critical to guarantee optimal performance and efficient resource…

NSX 4.X Certificate exchange of the NSX Manager

NSX 4.X Certificate exchange of the NSX Manager Certificate creation First of all, we need a CSR request. This can…

Podcasts

Edge Computing Modernization

Maciej comes from the old days like hardware ages. Remembers the definition of the cloud as a movement to another…

Edge Computing & AI

Everybody forgot about the Edge. But with our guest 𝙈𝙞𝙘𝙝𝙖𝙚𝙡 𝙍𝙤𝙙𝙚, EMEA VMware Channel Director at #dell Technologies, we discuss…

IT security from very different angles

In this episode, Maciej Lelusz talks about safety in the sense of leaving your comfort zone. That is the basis…